策展筆記 Vol.13

思想與智慧

🗞️ 社群新知 PLAYBOOK

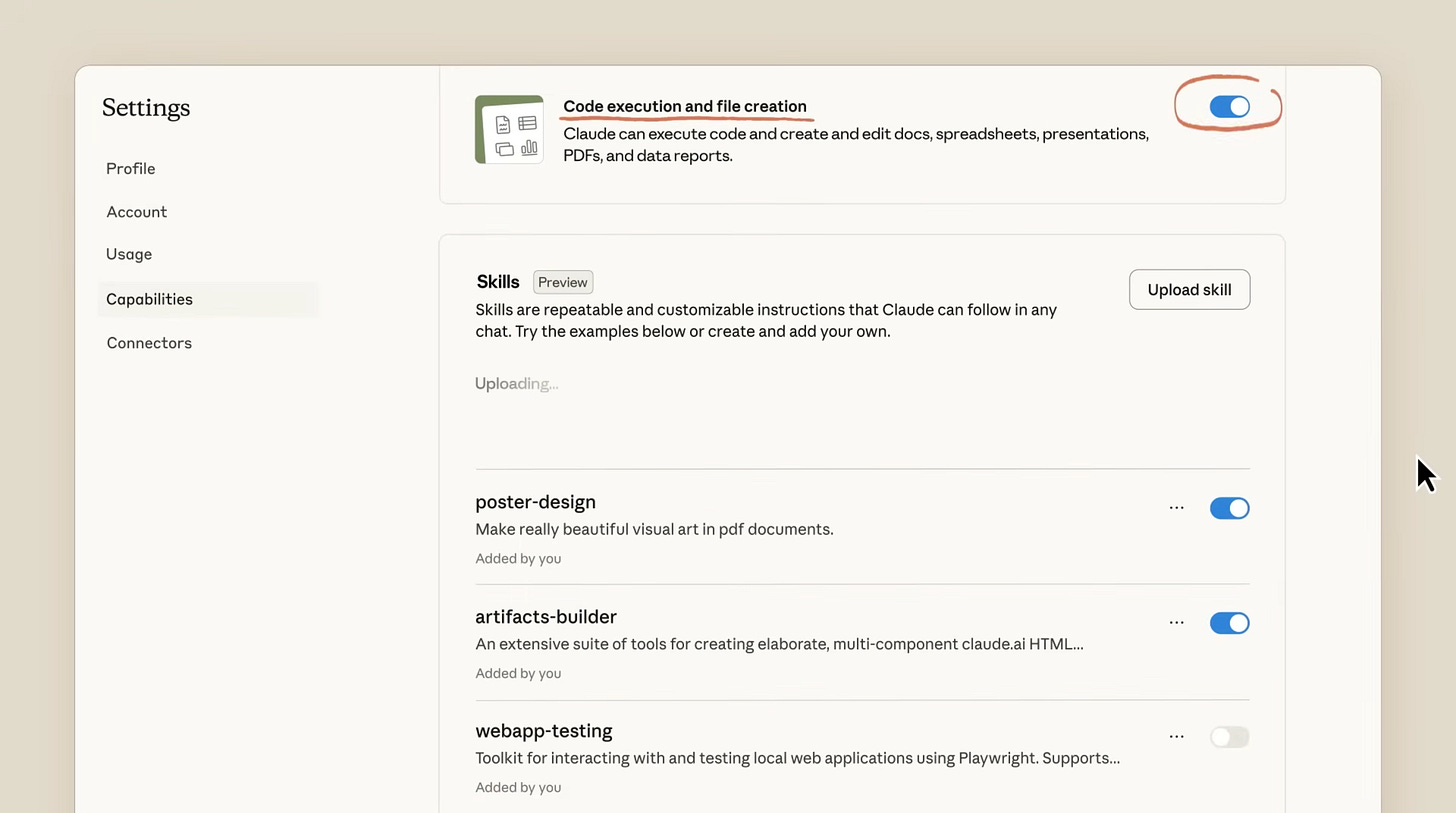

Claude Skills:把你的專業打包成 AI 隨時取用的外掛

(圖片來源: Anthropic)

AI 總是不懂你的公司內部規範或特定工作流程嗎?你是否厭倦了每次都要用冗長的 Prompt「提醒」AI 你的品牌色碼、寫作風格?

Anthropic 於 2025 年 10 月 17 日發布的 Claude「Skills」功能,正試圖解決這個痛點。

它讓使用者能將特定的指令、腳本和參考資料打包成一個個獨立的「技能包」資料夾,讓 Claude 在需要時能自動取用,把 AI 從一個通才,變成懂你需求的專家。

核心概念拆解:

⇨ 專屬任務外掛包:你可以把一個「Skill」想像成一個專屬資料夾,裡面裝滿了執行特定任務所需的說明和資源。例如,建立一個「公司品牌指南」的 Skill,包含官方的品牌顏色、字體和溝通語氣。當 Claude 執行相關任務時,就會自動載入這個技能,確保產出符合規範。

⇨ 智慧化自動調用:最方便的是,你不需要手動指定要用哪個 Skill。Claude 會在處理任務時,自動掃描並載入最相關的技能,而且只會讀取需要的最小化資訊和文件,以確保運作效率。它甚至能組合、堆疊多個 Skills 來處理複雜任務。

⇨ 一次建立,跨平台使用:你建立的 Skill 具備高度可攜性,在 Claude apps、Claude Code 或 API 中的格式都相同,可以一次建立、到處使用。甚至還有一個名為「skill-creator」的官方技能,能引導你以互動問答的方式,輕鬆建立自己的 Skill,無需手動編輯文件。

操作示例:

假設你是一位內容創作者,需要為不同平台產出風格各異的文案。你可以建立兩個 Skills:

「社群貼文風格」Skill:內含你的 IG 寫作語氣、常用的 emoji 和 hashtag 格式。

「深度文章風格」Skill:包含較為正式的寫作結構、引用資料的格式要求。

當你對 Claude 說:「幫我把這份筆記寫成一篇 IG 貼文」,它會自動啟用第一個 Skill,產出活潑、口語化的內容。若你說:「用這份筆記草擬一篇深度分析文章」,它則會改用第二個 Skill,生成結構嚴謹、風格專業的長文。

Claude Skills 的出現,代表我們與 AI 的協作模式,正從單次的「指令溝通」進化到可重複使用的「工作流賦能」。這讓 AI 的產出更穩定、更可預測,也讓每個團隊或個人,都能把自身的專業知識,真正內化成 AI 的一部分。

💡 創作者觀點 INSIGHT

snewman:別跟 AI 比博學,鍛鍊你的『流動智力』

(圖片來源:LESSWRONG - 35 Thoughts About AGI and 1 About GPT-5)

AI 在知識廣度上的超人表現,已是不爭的事實。這也讓創作者普遍陷入一種焦慮:當 AI 能在幾秒內寫出引經據典的文章時,我們還剩下什麼價值?

來自 LessWrong 社群的創作者 snewman 在其發人深省的文章《關於 AGI 的 35 個想法》中,提供了一個絕佳的分析框架,幫助我們重新定位自己的核心價值。

snewman 觀察到一個核心現象:

與人類相比,大型語言模型似乎在「晶體智力」(crystallized knowledge)上達到了超人水平,而這正掩蓋了它們在「流動智力」(fluid intelligence)上的缺陷。這個區分,恰好為創作者指出了在 AI 時代的生存之道。

晶體智力:指後天學習、累積而來的知識、事實與經驗。可以理解為「博學」。

流動智力:指在新情境中解決問題、識別模式、進行邏輯推理的能力。可以理解為「聰明」或「洞察力」。

觀點拆解:

⇨ AI 靠「博學」取勝,而非「聰明」:

snewman 指出,AI 在解決數學難題時,往往不是靠找到優雅、巧妙的解法,而是依賴於它龐大的知識庫,知道某個剛好能解題的冷僻定理,或是用暴力破解的方式硬算出來。

這種方式雖然能得到正確答案,卻無法提供過程中的「洞見」(insight)。

⇨ AI 在「學習效率」與「頓悟」上仍有障礙:

人類擁有一種 AI 難以企及的能力,叫做「樣本高效學習」(sample-efficient learning),也就是能從少量範例中快速掌握新技能或概念。例如,人類可以從幾個例子中就找出 ARC-AGI 謎題的規律,但 AI 卻對此感到非常困難。

snewman 認為,AI 的「脈絡中學習」可能只是在「喚醒記憶」,而非真正學會新概念。這種學習上的根本差異,限制了 AI 產生真正「頓悟」(aha moment)的能力。

行動應用:

放棄與 AI 比博學:別再把目標設定為成為一個「什麼都知道」的專家。承認 AI 在晶體智力上已是超人,把所有資料整理、事實查核、知識引用的工作都交給它。

刻意鍛鍊你的流動智力:將創作重心轉移到 AI 做不到的事情上。例如:為一個複雜問題找到一個巧妙的「重構」(reframing)視角;在看似無關的領域間建立獨特的類比與連結;培養自己對趨勢的「判斷力」(judgement)和對人性的「洞察力」(insight)。

把 AI 當作你的「外掛晶體智力」:讓 AI 成為你隨時可用的博學助理。你負責提出深刻的問題、定義獨特的框架,然後驅動 AI 龐大的知識庫來為你服務,讓你從繁瑣的知識勞動中解放,專注於產生真正的智慧火花。

當 AI 能提供無限的「答案」時,創作者的價值,就在於提出那個無法被輕易回答的、充滿洞見的「問題」。

⚙️ 創作工具 TOOL

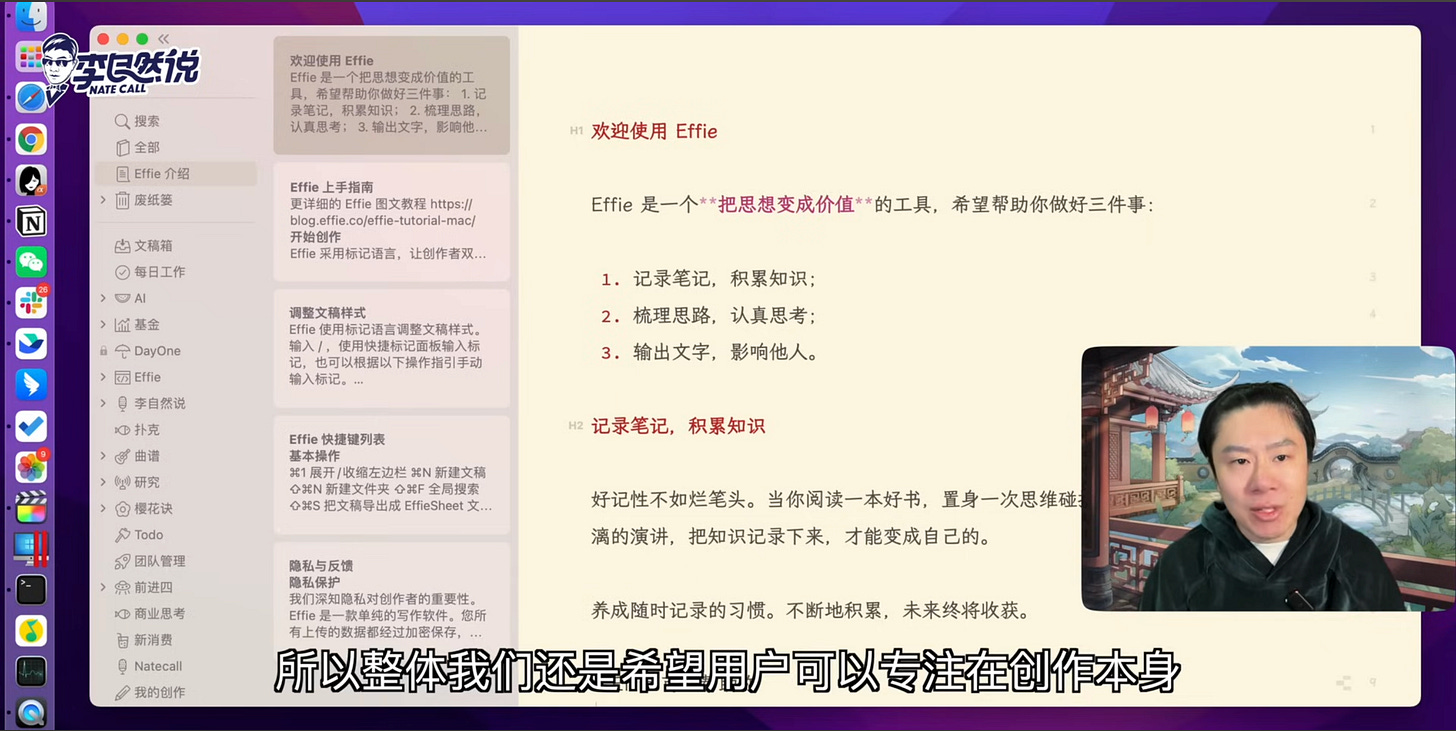

Effie AI:為「思想者」打造一個不受打擾的寫作空間

你是否也曾覺得,市面上強大的筆記軟體,學起來像是在鑽研另一門學問,反而離「寫作」越來越遠?

對於這一點,身兼創作者與產品經理的 Effie 創辦人李自然,顯然也深有同感。

他認為,許多軟體與其說是「寫作軟體」,不如說是為文案工作者設計的「文字處理軟體」,它們充斥著按鈕、彈窗,根本不是為真正的「思想者」所設計。

Effie 的誕生,正是為了解決這個核心痛點:為創作者提供一個能將腦中思想順暢轉化為文字的純粹空間。

工具解決方案:

Effie AI 的設計哲學是「退讓」,讓工具本身退到幕後,尊重創作者的內容。它透過幾個獨特的設計,實現了這種「沉浸式」的創作流程。

⇨ 思想一體化:無縫整合思維導圖、大綱與寫作

市面上大多數工具,要嘛只能做思維導圖,要嘛只能寫文章,創作者常常需要在兩個軟體間來回切換。

Effie 的核心正是打通了這個斷點,你可以用 AI 輔助進行腦力激盪,生成一張思維導圖;接著一鍵將其轉為大綱;最後再將大綱擴寫成一篇數千字的長文,整個過程都在同一個地方完成。

你的思想,無論是發散的導圖還是收斂的文章,都被安放在同一個地方。

⇨ 不打擾的 AI 助理:支持非同步、併發的 AI 協作

這是 Effie AI 最與眾不同的設計。多數 AI 工具在你下達指令後,都只能看著它一個字一個字地輸出,打斷你的創作心流。

Effie 的 AI 則像一個真正的助理:你可以隨時向它派發多個任務(例如,一邊潤飾A段落,一邊請它回答B問題,同時讓它擴寫C節點),然後繼續進行你自己的寫作,AI 會在後台完成工作,並在不打擾你的情況下呈現結果。

應用情境:

假設你要寫一篇關於「希臘神話」的文章,但你對此一無所知。

在 Effie 的空白頁面,呼叫 AI 進行「頭腦風暴」,主題是「希臘神話入門」。AI 會直接生成一張包含核心概念的思維導圖。

在導圖模式下,你覺得「宙斯」這個節點內容太少,可以選中它,讓 AI 根據上下文進行擴充。同時,你對「現代生活的起源」也很好奇,可以同時選中該節點讓 AI 擴寫。

當你對整個思維導圖的結構滿意後,點擊「轉換為長文」,AI 會在後台根據這張導圖,生成一篇數千字的完整文章。在這個過程中,你完全可以去做別的事,甚至關掉軟體。

Effie AI 體現了一種「反功能堆砌」的產品哲學。李自然認為,簡潔從不是靠做減法,簡潔的背後是更複雜、更精巧的構思。它的目標不是成為一個什麼都能做的「資訊資料庫」,而是專注做好「文字創作」這一件事。AI 在其中的角色,也始終是「副駕駛」,真正的靈魂永遠是創作者本人。

Effie AI 提醒我們,好的創作工具不應該追求功能的繁複,而應追求體驗的純粹。它不僅僅是一個軟體,更是一個為創作者劃清界線、可以安心獨處的空間,讓每一次寫作,都回歸到思想本身。

✍️ 瑞塔反思 REFLECTION

這週看了強化學習之父 Richard Sutton 的一篇訪談,感受非常震撼。

在整個 AI 領域都在為大型語言模型(LLM)的成就喝采時,他卻像一位冷靜的智者,從根本上提出了質疑:我們現在走的,或許是一條死胡同。

這篇訪談的價值,在於它迫使我們從狂熱中抽離,重新思考「智慧」的本質。Sutton 的觀點極具顛覆性,我整理出三個值得我們深思的啟發點:

▋啟發一:模仿的終點,不等於智慧的起點。

Sutton 指出,LLM 的核心是「模仿」,它們透過學習海量的人類文本,變得越來越會「說人話」。但這不代表它們理解世界。

他認為,真正的智慧,需要一個能影響外部世界的「目標」(Goal),並從真實的回饋(Reward)中判斷對錯好壞。LLM 缺乏這個機制,因此它更像一個精緻的「行為系統」,而非一個「智慧體」。

這提醒我們,能流利對話,與擁有真正的理解和推理能力,是兩件截然不同的事。

▋啟發二:「苦澀的教訓」正在上演 2.0 版本。

Sutton 著名的《苦澀的教訓》指出,依賴「人類知識」的 AI 方法,長期終將被更具擴展性的「通用計算方法」所超越。

他認為,LLM 正是最新、最龐大的「人類知識」集合體——整個網際網路的文本。他預言,未來能夠直接從「與世界的互動經驗」中學習的 AI,將會因為能獲取無限的、非人類產生的數據,而最終超越受限於文本資料量的 LLM。

我們正在見證的,或許只是下一個偉大突破前的序章。

▋啟發三:真正的智慧來自「體驗」,而非語言模仿。

Sutton 提出了他心中的正確路徑:「體驗式範式」。他認為,智慧的基礎,來自於生命體一生中不間斷的「感知、行動、獎勵」數據流。

AI 的知識,應該是關於「如果我採取某個行動,接下來會發生什麼」的陳述,並能被真實的經驗持續檢驗。

他認為,我們普遍相信的「模仿」並非學習的核心,真正的學習是像所有動物一樣,透過無數次的「試錯」(trial-and-error)來建立對世界的認知。

這就是為什麼他會說出「如果我們能理解一隻松鼠,我們就幾乎完全理解了人類智慧」這樣驚人的話,因為在他看來,語言和文化,只是附著在這個共通學習機制上「薄薄的一層鍍金」。

Sutton 的觀點像一面鏡子,照見了當前 AI 發展的根本路線之爭:真正的智慧,應該是窮盡人類所有知識的「模仿者」,還是一個從零開始、透過自身與世界互動來學習的「探索者」? 這個問題,或許定義了 AI 的未來。